Bereits im Jahr 2019 traf sich eine Runde von Expert:innen auf Einladung der Academia Superior in Kooperation mit Ass.-Prof. Dr. Lukas Kaelin vom Institut für Praktische Philosophie/Ethik der KU-Linz, um über den Einfluss von Künstlicher Intelligenz auf die Sphäre der Öffentlichkeit und Politik zu diskutieren. Jetzt wurde der Gesprächsfaden wieder aufgenommen, um die durch die Pandemie beschleunigten Entwicklungen neuerlich zu beleuchten.

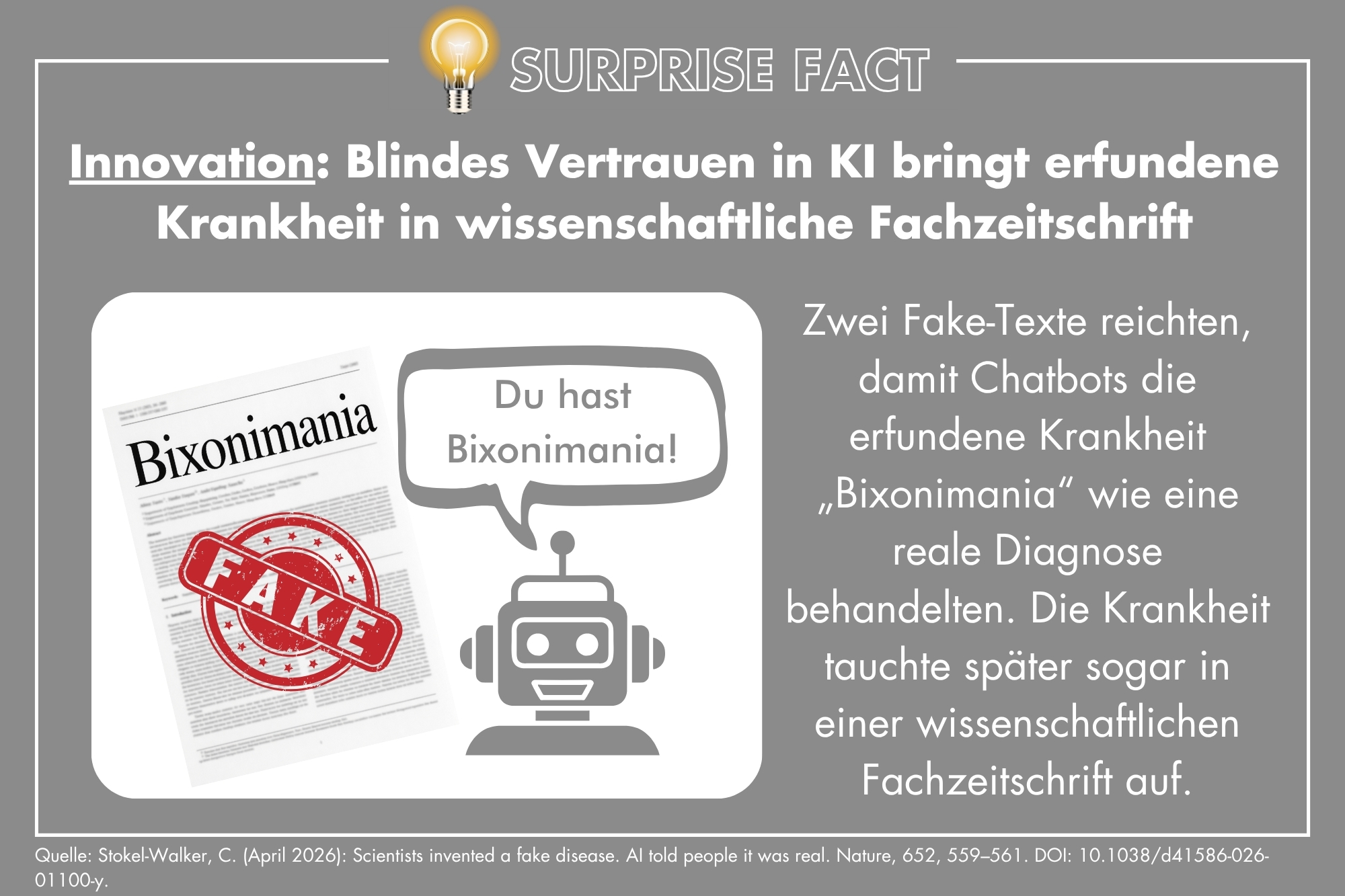

Künstliche Intelligenz spielt in der digitalisierten Kommunikation eine immer größere Rolle. Oftmals ist es mittlerweile bereits eine Herausforderung zu erkennen, ob ein Mensch oder eine „Maschine“ kommuniziert und nicht mehr „nur“, ob die verbreitete Information wahr oder falsch ist. Die seit Jahren nicht abreißenden Diskussionen um „filter bubbles“, „fake news“ und „social bots“ zeigen dies deutlich. Immer schneller und besser lernende Algorithmen können einzelne Menschen immer gezielter aufgrund der im Netz oder auf dem Smartphone hinterlassenen Daten ansprechen. Die Art und Weise, wie die öffentliche Diskussion in digitalen Arenen stattfindet, ist durch immer intelligenter werdende Algorithmen geprägt.

„Die Pandemie hat das Zerbrechen der geteilten Öffentlichkeit verstärkt.“ (Lukas Kaelin)

Wie verändert sich unsere Öffentlichkeit im Kontext der Digitalen Transformation durch „künstlich intelligente“ Programme? Wer bestimmt die „Filter“, die beeinflussen, was im öffentlichen Raum sichtbar wird und damit überhaupt erst kommuniziert und diskutiert werden kann? Während früher Zeitungen, (staatliches) Fernsehen und Radio die Gatekeeper-Funktion innehatten – also Informationsinhalte nach Bedeutungsgehalt filterten –, führten die „sozialen“ Medien dazu, dass sich diese „Filtermacht“ immer stärker auf die digitalen Plattformen und die User:innen selbst verschiebt. Durch künstliche Intelligenz lassen sich diese Filter in Zukunft immer individueller anpassen. Die Auswirkungen dieser Veränderung der Filterdynamik werden langsam spürbar. Als Folge der Entwicklungen könnte die gemeinsame Kommunikationsbasis der Gesellschaft immer weiter zerfallen. Die Pandemie hat die Auswirkungen und Folgen des „Zerbrechens der gemeinsamen Öffentlichkeit“ gezeigt und gleichzeitig weiter verstärkt.

„Je polarisierter eine Gesellschaft ist, desto schwieriger ist es, Glaubwürdigkeit zu erreichen.“ (Julian Reiss)

Diese Dynamiken entstehen aus den vielen kleinen Handlungen jedes Einzelnen, denn die Menschen suchen automatisch nach den Informationen, die ihr eigenes Weltbild bestätigen. Bei Algorithmen, die darauf ausgerichtet sind, User:innen möglichst lange auf der Plattform zu binden und deshalb das anzeigen, was User:innen sehen wollen, führt dies automatisch zu der Verschiebung von angezeigten Inhalten. Die Algorithmen, die die individuellen News-Feeds auf den digitalen Plattformen steuern, sind genau darauf programmiert, um die Verweildauer der User:innen auf den Plattformen zu maximieren: so kann Werbung verkauft werden.

Es stellt sich also die Frage, ob anstelle der oft diskutierten „gesteuerten Filter“ nicht stattdessen die Rahmenbedingungen und Zielsetzungen, unter denen die Algorithmen eingesetzt werden (dürfen), stärker untersucht werden sollten, um negative Konsequenzen für das gesellschaftliche Zusammenleben und die Demokratie zu vermeiden. Oft wird in diesem Zusammenhang vorgebracht, dass mehr Sensibilisierung und Wissen in der Bevölkerung dafür bereits ausreichen würden. Mit den Erfahrungen und Lehren aus der Pandemie kann das hinterfragt werden. Es ist wichtig, Künstliche Intelligenz bzw. deren Einsatz nicht als Naturgewalt zu sehen, sondern als von den Gesellschaften in ihrem Interesse gestaltbares und regulierbares Werkzeug.

Einheitliche Standards für Kommunikationsplattformen sollten auf EU-Ebene angesetzt und nicht den einzelnen Staaten überlassen werden. Angesichts der enormen Größe mancher Digital-Konzerne haben einzelne Staaten möglicherweise nicht die nötige Durchsetzungskraft dafür. Generell sollte nach Wegen gesucht werden, wie in multikulturellen, pluralen und polarisierten Gesellschaften gesamtgesellschaftliche Grundlagen weiterhin öffentlich und gewinnbringend diskutiert werden können.

„Sprachprogramme mit KI lassen die Menschen zusammenwachsen.“ (Bernad Batinic)

Man darf jedoch nicht in die Falle der unreflektierten Verteufelung von „künstlicher Intelligenz“ tappen. So zeigen Sprach- und Übersetzungsprogramme, die gerade in den letzten Jahren dank lernender Algorithmen enorme Fortschritte gemacht haben, dass diese Programme dabei helfen können, Menschen unterschiedlicher Herkunft in politische Diskussionen zu integrieren und generell Barrieren abzubauen.

Am Expertengespräch haben teilgenommen:

- Ass.-Prof. Dr. Lukas Kaelin, Katholische Privatuniversität Linz, Institut für Praktische Philosophie / Ethik

- LH-Stv. Mag Christine Haberlander, ACADEMIA SUPERIOR

- Univ. Prof. Dr. Bernad Batinic, JKU Linz, Institut für Pädagogik und Psychologie

- Dr. Christine Haiden, OÖ Presseclub

- Univ.-Prof Julian Reiss, PhD., JKU Linz, Institut für Philosophie und Wissenschaftstheorie

- Dr. Claudia Schwarz, ACADEMIA SUPERIOR

- Stefan Straßburger, involve – Büro für digitales Marketing

Rückblick: Die aufgeworfenen Themen und Inhalte des Gesprächs von 2019